產品詳情:

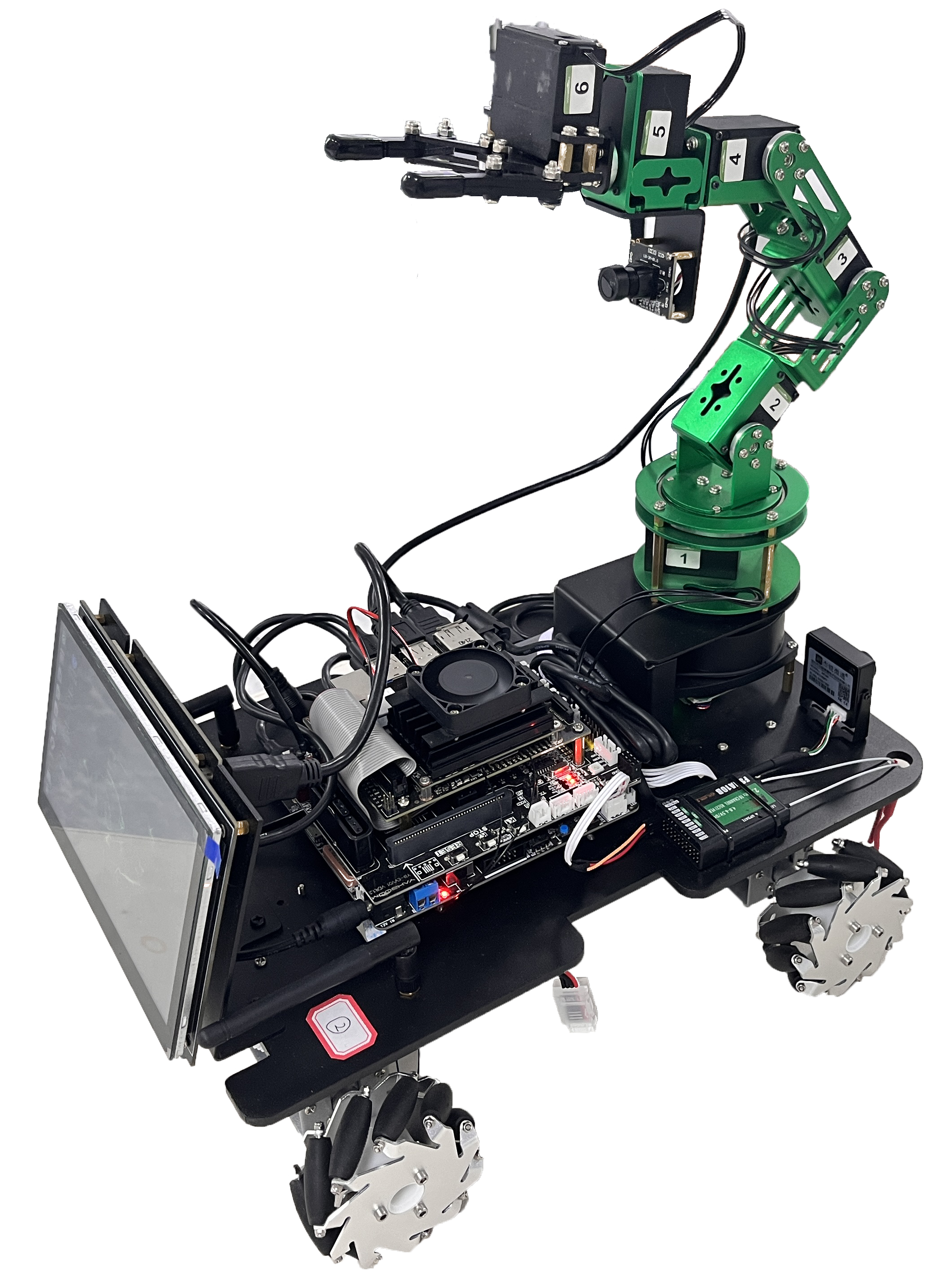

多維運動控制平臺以四驅小車為基礎,集成電機/舵機驅動控制器,支持小車和機械臂的精準運動控制,同時搭載豐富的傳感器實現環境、預警、定位等各種數據的采集和監控,配合無線通信模塊,實現人工智能感覺、動作系統的開發和學習。感控單元主控平臺采用 STM32 高性能處理器,可完成嵌入式與傳感器、機器人控制技術課程的學習。配合智能邊緣計算網關,能夠完成基于 ROS 系統的機器人協作開發課程的學習。

智能網關:

?處理器:64位四核CORTEX-A57,128核MAXWELL GPU;

?內存:4GB LPDDR,板載存儲:64GB;

?接口:USB3.0×4,Micro USB×1, HDMI×1,RJ45×1,DC5.5×2.1電源接口;

?集成Linux、Python等運行環境,支持數字圖像處理、機器視覺、深度學習等算法、硬件、應用的開發和學習。

?搭載 7 寸 LVDS 高清屏。

?AI 自動駕駛平臺車體不小于 360mm*210mm*350mm,

?采用高性能雙路 ARM Cortex-M4 STM32G4 控制器單元,

?提供電機驅動及傳感驅動。

?四驅獨立懸掛輪式駕駛底盤,大功率減速電機。

(1)運動控制模塊

在機器人中用到很多控制器和外設,包括:處理器、激光雷達,STM32控制器,電機、編碼器、雙路驅動、藍牙、PS2有線手柄、航模遙控、陀螺儀等,同時提供了串口1和CAN接口方便用戶拓展控制,這些控制器與控制器,外設與控制器之間的連接,如圖所示。

(2)ROS操作系統

ROS操作系統內置于中央處理器內,通過RTOS完成系統任務調度與管理。具體任務調度管理流程如圖所示。RTOS任務調度器根據任務的優先級決定任務的執行順序,每個任務執行的時間很短,因此幾乎等效于所有任務同時執行,期間如果發生中斷則去響應中斷。串口2中斷用于APP藍牙控制,串口3中斷用于接收ROS傳過來的信息。

(3)JetsonNano邊緣計算平臺

NVIDIA Jetson Nano是一個小巧卻功能強大的計算機,它可以讓你并行運行多個神經網絡、對象檢測、分割和語音處理等應用程序,Jetson Nano搭載四核cortex-A57處理器,128核MaxwellGPU及4GB LPDDR內存,帶來足夠的AI計算能力,提供472GFLOP算力,并支持一系列流行的Al框架和算法,比如TensorFlow、Pytorch.caffe/caffe2、Keras、MXNET等

(4)激光雷達

相較于傳統技術,利用紅外激光設備可實現超大屏幕的多點觸摸,其反應更快、精度更高、抗環境光能力更強。激光雷達作為核心傳感器,可快速獲得環境輪廓信息,配合SLAMWARE使用,可以幫助機器人實現自主構建地圖、實時路徑規劃與自動避開障礙物。應用領域智能掃地機、家用機器人。

測量半徑:12米,測量頻率:8000次/秒,掃描頻率:5.5HZ,360度掃描測距

(5)機器視覺-雙目深度體感攝像頭

雙目深度體感攝像頭是VR/AR、機器人和無人駕駛最核心的技術支撐之一,而深度攝像頭就是這類硬件的眼睛。只有機器對“看到的”東西,定位定姿精度更高時,才能更好地識別和做出判斷,從而提升機器的可用性和產品化速度。利用雙目立體視覺成像原理實現三維定位,即可進行手勢、肢體動作的綜

使用距離:0.8m至 3.5m之間,視野:58° H, 45 V, 70° D(水平,垂直,對角),傳感器:深度,深度影像大小:VGA(640x480) : 30fps,QVGA (320x240): 60fps,接口:USB2.0

(7)六自由度機器臂

視覺機械臂以Jetson Nano為主控,Open Source CV為圖像處理庫,以主流的Jupyter Lab為開發工具,使用Python3為主要編程語言。攝像頭與機械臂機身一體式設計,“手眼合一”的視覺識別讓機械臂顯得更加靈動,它不僅可以實現顏色識別追蹤與抓取,還能人體特征識別互動,甚至進行垃圾分類模型訓練垃圾分揀;通過RO5機器人操控系統,簡化了6自由度串行總線舵機復雜運動控制。

1080P攝像頭:感光元件尺寸:1/237”最高有效分辨率:1928*1088;數據格式:YUY2/MJPG;像素大小:3.0μm*3.0μm;寬動態范圍:96DB;自動控制:飽和度,對比度,銳度,白平衡,曝光。

機械臂:Cortex-M3內核的處理器控制板,自由度桌面式機械臂,大功率串行總線智能舵機,臂展350mm,負載≥300g,帶夾爪,陽極氧化處理鋁合金機身,主要用于工業機械臂的控制。支持python編程,可靈活和精準調節每一關節角度和位置;支持PC上位機、手機APP、USB游戲手柄控制;

工程應用方向

機器導航應用

同時定位與地圖構建(Simultaneous Localization And Mapping,簡稱 SLAM),通常 是指在機器人或者其他載體上,通過對各種傳感器數據進行采集和計算,生成對其自身位置姿態的定位和場景地圖信息的系統。SLAM 技術對于機器人或其他智能體的行動和交互能力至為關鍵,因為它代表了這種能力的基礎:知道自己在哪里,知道周圍環境如何,進而知道下一步該如何自主行動。它在自動駕駛、服務型機器人、無人機、AR/VR 等領域有著廣泛的應用,可以說凡是擁 有一定行動能力的智能體都擁有某種形式的 SLAM 系統。

視覺導航

AI 視覺/語言/控制多維平臺通過多維景深攝像頭立體視覺感知完成圖像處理,支持 語音識別、背景移除、增加現實、3D 掃描、目標跟蹤、面部處理等,實現基于 ROS 系統 的深度攝像 SLAM 導航和構圖。

實驗內容

移動機器人控制實驗

?相機標定

?動態目標跟隨

?基礎運動控制

?機器人驅動系統

?視覺巡線

?Gmapping建圖

?激光雷達建圖與導航

?交通燈識別

?交通標志識別

?車道識別實驗

?人臉追蹤

機器人檢測與感知實驗

?機器人視覺感知

?移動機器人自主定位與姿態傳感

?移動機器人未知環境感知

?移動機器人視覺測距

綜合應用課程設計

?基于SVM的交通標志識別系統設計

?基于深度學習的車道線檢測與自適應巡航設計

?基于樸素貝葉斯的移動機器人自助避障系統設計

?基于循環神經網絡的車牌識別系統設計

?基于CNN與SVM的交通標志的識別系統設計

?基于HOG與SVM的交通標志識別系統設計

?基于深度學習的車道線檢測系統設計

登錄

登錄

注冊

注冊